Ah l'évaluation dans les études, tantôt détestée, tantôt adorée. Pour les enseignants et enseignantes, c'est un temps d'écoute du travail produit par les étudiants et étudiantes. Pour l'institution, c'est ce qui permet de certifier une progression dans le parcours scolaire. Et pour les étudiants et étudiantes eux-mêmes, c'est souvent vécu comme une mise à l'épreuve.

De tous les points de vue, l'évaluation est un enjeu très important.

Mais c'est aussi un enjeu profondément bousculé par l'IA générative.

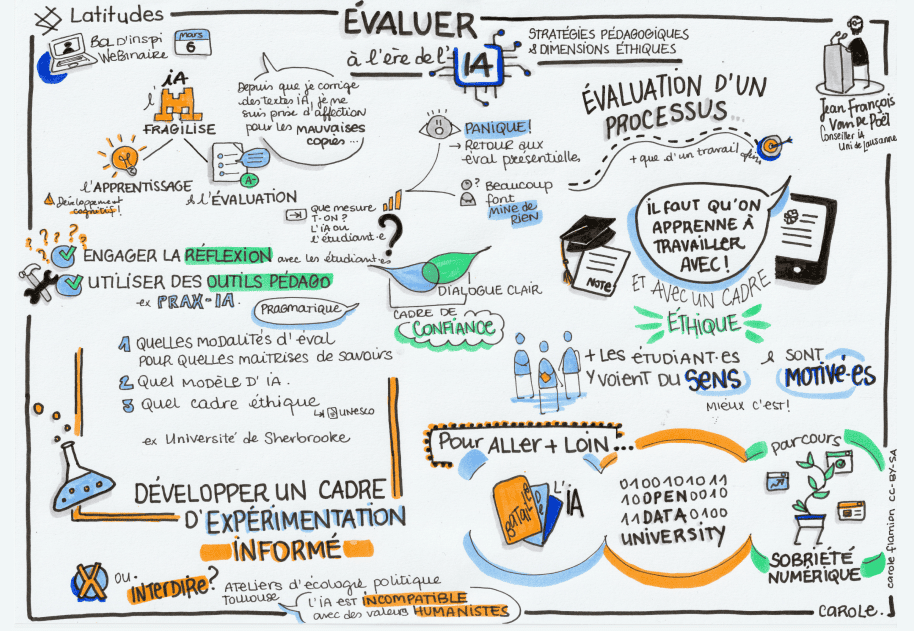

En décembre dernier, nous entendions d’ailleurs à ce sujet qu'à l'ère de l'IA, "certains types d'évaluation ne mesurent plus ce qu'elles étaient censées mesurer" (Webinaire - Direction générale de l'enseignement supérieur et de l'insertion professionnelle). Une phrase qui a ouvert tellement de questions que l'on a décidé d'y consacrer un Bol d'inspi entier.

Pour nourrir la discussion, nous avons invité Jean-François Van de Poël, conseiller IA enseignement à l’Université de Lausanne, et créateur du modèle PRAX-IA.

⌛️ Un petit tour d'horizon de l'article ?

1. Ce que l'IA vient fragiliser dans l'évaluation

2. L’importance de créer un dialogue avec ses étudiants et étudiantes

3. Des cadres pour faire des choix informés

4. Les considérations éthiques

5. Les impacts de l’IA ne s’arrêtent pas là

6. Faire un pas de côté sur l’IA

7. Explorons, ensemble, le numérique depuis ses marges !

1. Ce que l'IA vient fragiliser dans l'évaluation

Avant de parler d’IA : que mesurent concrètement ces différents moments d’évaluation dans l’enseignement supérieur ? Selon Jean-François, il y a une grande liberté pédagogique sur le sujet, chaque enseignant et enseignante adapte ses modalités en fonction de son cours. Mais globalement, l'évaluation remplit deux fonctions principales : valider la maîtrise des concepts de base, et valider la capacité à les mobiliser dans des situations complexes (ex : une dissertation, un travail de fin d'études, etc.).

Mais l’évaluation, elle a aussi un rôle social, puisqu’elle délivre des diplômes, et un rôle formatif, puisqu’elle permet aux étudiants et étudiantes de mesurer où ils et elles en sont, à plusieurs moments de leur parcours, sans la pression normative d'une note finale.

"Mais je trouve que ce qu’il manque dans l’enseignement supérieur, c’est cette question du sens et de la motivation". Car pour Jean-François, en allant chercher "la note", les élèves passent parfois à côté de ce qu'on cherche vraiment à mesurer.

Que vient donc réellement fragiliser ou remettre en question l’IA ?

Pour Jean-François, le problème se pose à deux niveaux :

- D’abord, pour les enseignants et enseignantes, il y a un problème de mesure, si l’étudiant ou l’étudiante utilise l’IA : qu'est-ce qu'on mesure exactement, le travail de l’élève, ou celui de l’IA ? Et si on pousse un cran plus loin la réflexion sur l’évaluation, qu’est-ce qu’on évalue : un travail fini (c’est le cas aujourd’hui) ou pourrait-on évaluer le processus, et l’impact de l’IA sur le travail produit. Pour Jean-François, c'est là qu'il y a une opportunité. L'IA peut être l'occasion de ne plus tout mettre sur le rendu final, mais davantage sur le processus.

- Et l’IA peut également avoir un impact lors de la phase d’apprentissage des étudiants et étudiantes : "moi, je n'ai pas de problème avec l'IA car je n'autorise pas les outils numériques pendant mes évaluations" est une phrase que l'on peut par exemple entendre chez un enseignant ou une enseignante. Mais exclure l'IA de l'évaluation ne suffit pas, car elle s'immisce ailleurs : dans les révisions, les fiches, les QCM, les résumés, etc. En déléguant ces tâches, les étudiants et étudiantes contournent les actes cognitifs essentiels à l'apprentissage et n'apprennent pas vraiment. D'où l'importance de les sensibiliser, dès aujourd'hui, au danger d'apprendre avec l'IA. Si l'IA peut être écartée de l'évaluation, elle ne peut pas l'être de l'apprentissage lui-même.

2. L’importance de créer un dialogue avec ses étudiants et étudiantes

Dans le rapport "IA et Enseignement Supérieur : Formation, Structuration et Appropriation par la Société" réalisé en juin 2025, on peut y lire deux nombres clés :

- 47% des enseignants et enseignantes ne prennent pas en compte l’usage de l’IA par les étudiants et étudiantes

- 70% ne font pas utiliser l’IA à leurs étudiants et étudiantes

Lorsqu’on revient dessus durant le bol d’inspi, la réaction de Jean-François est sans appel : "le problème, c’est que beaucoup d’enseignants et enseignantes font encore mine de rien".

Cela dénote avec celles et ceux qui ont mis en place des cadres, interdit l'IA, ou encore arrêté certains travaux à la maison pour les remplacer par des évaluations en présentiel (comme ce fut le cas dans certaines universités anglo-saxonnes).

La posture qu’il préconise : faire des choix informés, mais aussi, créer un dialogue avec ses étudiants et étudiantes.

Car utiliser des méthodes d'évaluation qui ne sont pas en danger avec l'IA (comme les oraux) ne veut pas dire que l'apprentissage, lui, ne le sera pas. "On a pas mal de profs qui constatent chaque année dans leurs évaluations que les notes diminuent parce qu'on a des étudiants qui apprennent mal avec l'IA.”

Quelques conseils pour instaurer un dialogue sur l’IA avec ses élèves :

- Les avertir et les sensibiliser aux dangers d’apprendre avec l’IA (on l’a dit plus haut, mais si on ne fait pas les choses soi-même, on n'apprend pas vraiment).

- Créer un cadre de confiance : définir, avec ses élèves, quand il est permis (ou non) d’utiliser l’IA (ex : brainstorming, aide à la recherche de littérature, etc.) L'idée n'est pas d'interdire, mais de poser ensemble des règles claires sur ce qu'on peut faire, ou non, avec l'IA.

- Accompagner (et former) à l’utilisation de l’IA : avant d’ouvrir les portes de l’IA dans votre classe, donnez toutes les clés à vos étudiants et étudiantes pour l’utiliser et formez-les aux compétences IA. Avant de vous lancer, appuyez-vous sur des cadres référentiels de compétences qui existent déjà

- Le référentiel UNESCO (2023)

- L'OCDE (2025) a développé 9 indicateurs de capacités IA sur une échelle à 5 niveaux.

3. Des cadres pour faire des choix informés

👉 L’exemple de l'Université de Sherbrooke

Pour l'Université de Sherbrooke, "adopter une démarche transparente implique de préciser les usages permis et les conditions d’utilisation des IAg de manière globale ou ponctuelle". Alors, depuis mai 2024, l'Université de Sherbrooke propose un cadre pour préciser les usages permis et les conditions d'utilisation des IA génératives. Le principe est simple : des balises, numérotées de 0 à 4, sont renseignées par l'enseignant ou l'enseignante pour chacune des situations d'apprentissage et d'évaluation de son cours (0 = aucun usage de l'IA autorisé / 4 = usage libre).

Ces niveaux ne sont pas prescrits par l'institution. Chaque enseignant et enseignante reste libre de ses choix. Ils servent plutôt de balises pour encadrer l'utilisation des outils d'IA générative dans les situations d’apprentissage et d’évaluation.

Ici, la transparence de la démarche est essentielle. Il est indispensable de communiquer clairement aux étudiants et étudiantes ce qu'on attend d'eux, et dans quelles conditions l'IA peut, ou ne peut pas être utilisée.

%20(1).png)

👉 L’exemple du modèle PRAX-IA, développé par Jean-François Van de Poël à l’université de Lausanne

"Pourquoi j'ai développé PRAX-IA ? Si je me mets à la place d'un prof, je me dis : en quoi mes travaux académiques sont-ils mis en danger ?"

Pour Jean-François, l'IA fait désormais partie du quotidien des étudiants et étudiantes, et elle fera partie de leur vie professionnelle. Il faut donc apprendre à s'en servir, mais dans un cadre éthique. L'idée de ce modèle : décider, pour chacun des travaux, de ce qui est possible de faire ou non avec l'IA, et instaurer un dialogue avec les étudiants et étudiantes.

C'est dans cet esprit qu'a été développé PRAX-IA : un parcours de réflexion interactif pour analyser, adapter et renforcer ses pratiques d'évaluation face aux défis de l'IA.

Comme on peut le lire ici, PRAX-IA a été élaboré comme un cadre de soutien à une réflexion structurée. Il s’appuie sur une revue de littérature en lien avec les pratiques pédagogiques et les applications de l’IA. PRAX-IA vise à soutenir les enseignants et enseignantes dans leurs interrogations et leurs choix pédagogiques en leur offrant des outils pratiques et un ensemble de ressources à consulter.

Ce modèle s’appuie sur deux axes principaux : une entrée spécifique par le biais des évaluations référencées dans la littérature et une réflexion plus globale sur l’impact de l’IA dans l’ensemble du cours. Chaque axe est enrichi par une base de connaissances documentée et par des ressources pratiques, accessibles via un espace dédié.

.png)

Concrètement, PRAX-IA est une aide au positionnement pour les enseignants et enseignantes : il permet de cartographier les compétences visées dans leurs évaluations, et d'identifier celles qui peuvent être partiellement déléguées à l'IA, et celles qui doivent rester humaines.

Car, comme on peut le lire sur le site de PRAX-IA, "si vous permettez l'IA, identifiez les compétences à développer ! Comme le souligne Jason Lodge (TEQSA, 2023), les compétences les plus critiques sont humaines : pensée critique, jugement évaluatif, créativité conceptuelle, sens éthique." Privilégions les compétences humaines avant les compétences techniques.

4. Les considérations éthiques

Quand on parle de compétences IA, dans l'imaginaire des gens, il est vrai qu’on pense spontanément à la technique (par ex : développement web, comprendre les algorithmes, maîtrise des outils, etc.). Pourtant, dans les référentiels UNESCO et OCDE, les deux premières catégories de compétences sont éthiques et critiques.

"Les premières compétences à développer chez les enseignants et enseignantes, mais aussi chez les étudiants et étudiantes, elles sont éthiques, elles sont sociétales ” selon Jean-François.

En somme… il faut maîtriser l’éthique, avant la technique.

Beaucoup d'enseignants et d'enseignantes pensent être capables de reconnaître un travail fait par l'IA. Des études mentionnées par Jean-François montrent que ce n'est pas le cas, “dans 50 % des cas, ils et elles se trompent”. C'est en train de créer un biais d'évaluation : "on lit un travail d'étudiant, et on se sent convaincu, nous prof, d'identifier une présence de l'IA, et du coup on va pénaliser des travaux alors qu'ils ne sont pas faits avec l'IA. Donc on se trompe, il faut en être conscient.”

"Ce que je trouve dommage en termes d'éthique, c'est qu'on est, à cause de la presse, beaucoup dans cette apologie de la triche. La triche est partout, nos étudiants sont des tricheurs. Mais je me mets en faux par rapport à ça. L'étudiant a une conscience éthique, il ne faut pas l'oublier. C'est bien de lui rappeler les cadres éthiques par rapport à ces questionnements, et d'avoir un dialogue avec lui ou elle."

D’ailleurs, pour permettre un usage éthique de l'IA dans les travaux académiques et ouvrir un dialogue avec ses étudiants sur "ce qui est éthiquement acceptable, ou non", Jean-François s'appuie sur les 4 piliers de l'éthique scientifique, tels que définis par le Code d'intégrité scientifique des Académies suisses des sciences (2021) :

- Fiabilité : garantir la qualité et la reproductibilité des travaux. Tout résultat généré avec l'IA doit pouvoir être vérifié, validé et reproduit.

- Honnêteté : mener ses activités avec transparence et impartialité, et déclarer systématiquement l'usage de l'IA et son rôle dans le travail.

- Respect : considérer les personnes, la société et l'environnement. Cela inclut l'impact environnemental des choix technologiques, la propriété intellectuelle, et la confidentialité des données.

- Responsabilité : assumer l'entièreté de son travail et répondre de ses choix méthodologiques. L'IA n'est ni auteure ni co-auteure, l'étudiant reste seul responsable du contenu final.

5. Les impacts de l'IA ne s'arrêtent pas là

Toujours dans le rapport "IA et Enseignement Supérieur : Formation, Structuration et Appropriation par la Société", on peut lire que plus de de 90% de la communauté de l'enseignement supérieur (enseignants, enseignantes, étudiants et étudiantes) voit des risques à l'utilisation de l'IA. Mais près de 60 % des étudiants et étudiantes et 43 % des enseignants et enseignantes n'ont reçu aucune formation à l'IA.

L’usage de l'IA s'inscrit dans un contexte plus large : désinformation, pollution massive, dégâts sociaux, enjeux géopolitiques, inégalités d'accès. Autant de raisons de sensibiliser les étudiants et étudiantes, et les enseignants et enseignantes, aux impacts réels de l'IA, bien au-delà de la salle de cours.

Pour Jean-François, "quand on veut utiliser l’IA, on doit se demander quelle est la tâche que l’on veut réaliser, et on doit aussi habituer les étudiantes et étudiants à travailler sans l’IA". Du côté de l’impact environnemental, la question se pose aussi ici : quand est-ce nécessaire ? Pour la grande majorité des besoins classiques d'un cours, un modèle d’IA installé localement sur ordinateur suffirait amplement :"Pas besoin d'un bazooka pour tuer une mouche". Avant d’engager un acte qui a un impact sur l’environnement : demandez-vous si c’est un acte nécessaire et réfléchi ?

Et les enjeux ne s'arrêtent pas là. Une étude dont nous parlait Jean-François menée à Sciences Po sur l'usage de l'IA par les étudiants et étudiantes révèle que pour les étudiants de Bachelor, l'IA est devenue un véritable compagnon social qui rassure. Pour Jean-François, la substitution systématique de l'IA pour faire des travaux intellectuels amène une perte cognitive et des dangers pour le développement cognitif des jeunes (et aussi des moins jeunes !). Il est donc indispensable de sensibiliser à ces enjeux.

6. Faire un pas de côté sur l’IA Générative

Si Jean-François choisit d'accompagner les enseignants et enseignantes dans l'usage de l'IA, d'autres voix s'y opposent. Le 1er décembre dernier, l'Atelier d'écologie politique (Atécopol), collectif toulousain regroupant 300 scientifiques engagés face à l'urgence écologique, a publié un manifeste intitulé "Face à l'IA générative, l'objection de conscience", à destination des membres de l'enseignement supérieur, de la recherche et de l'éducation nationale. Rapidement, près de 2 800 enseignants, enseignantes, chercheurs et chercheuses l'ont signé.

Le texte soutient que le déploiement massif de l'IA générative dans leurs institutions est incompatible avec les valeurs humanistes fondamentales qu'elles sont censées porter pour des raisons écologiques, sociales et démocratiques.

Comme on peut le lire dans le manifeste, trois raisons majeures justifient cette position :

- Écologique : l'IA générative est "un gouffre énergétique et matériel" incompatible avec l'Accord de Paris et la protection du vivant. "Accepter le déploiement de l'IA générative, c'est amplifier le dépassement des limites planétaires."

- Sociale : l'IA générative "agit comme un accélérateur des infrastructures industrielles" et renforce de "lourds dégâts sociaux" : travail précaire, non-respect des droits humains, etc.

- Démocratique : la banalisation de l'IA générative "ouvre la voie à un futur dystopique" et permet à des mégafirmes d'accumuler "un pouvoir démiurgique", dont les dirigeants "ne font pas mystère de leurs projets mégalomaniaques, eugénistes et de leur détestation de la démocratie."

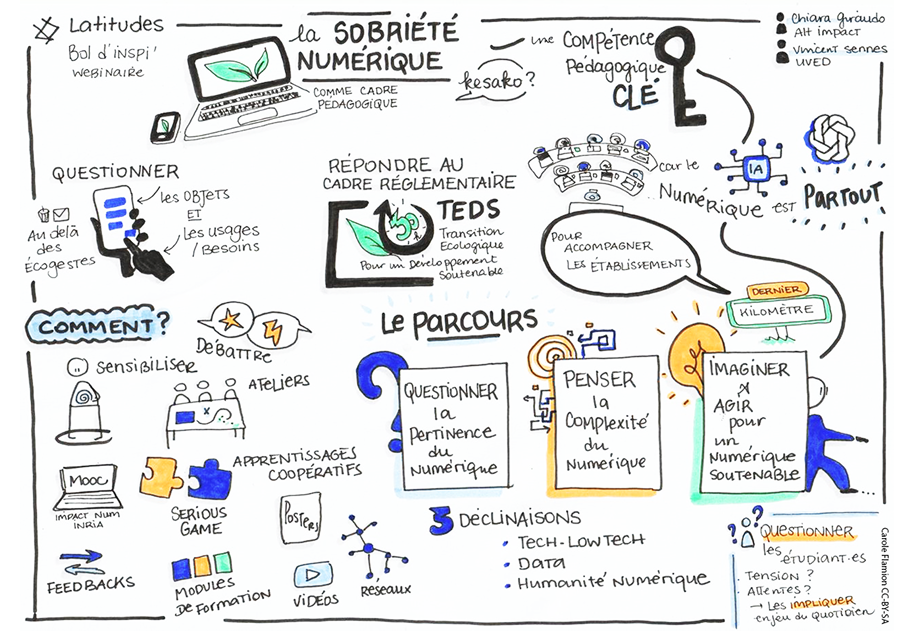

Explorons, ensemble, le numérique depuis ses marges !

Chez Latitudes, nous croyons que questionner notre utilisation - ou non - de l’IA est essentiel pour préserver notre puissance personnelle, et c’est d’ailleurs le cœur de notre mission. 🙂

En explorant le numérique depuis ses marges, Latitudes outille celles et ceux qui veulent creuser sous la surface de nos écrans, afin de redonner à chacune et chacun le pouvoir de choisir la place que le numérique occupe dans leur vie et dans la société.

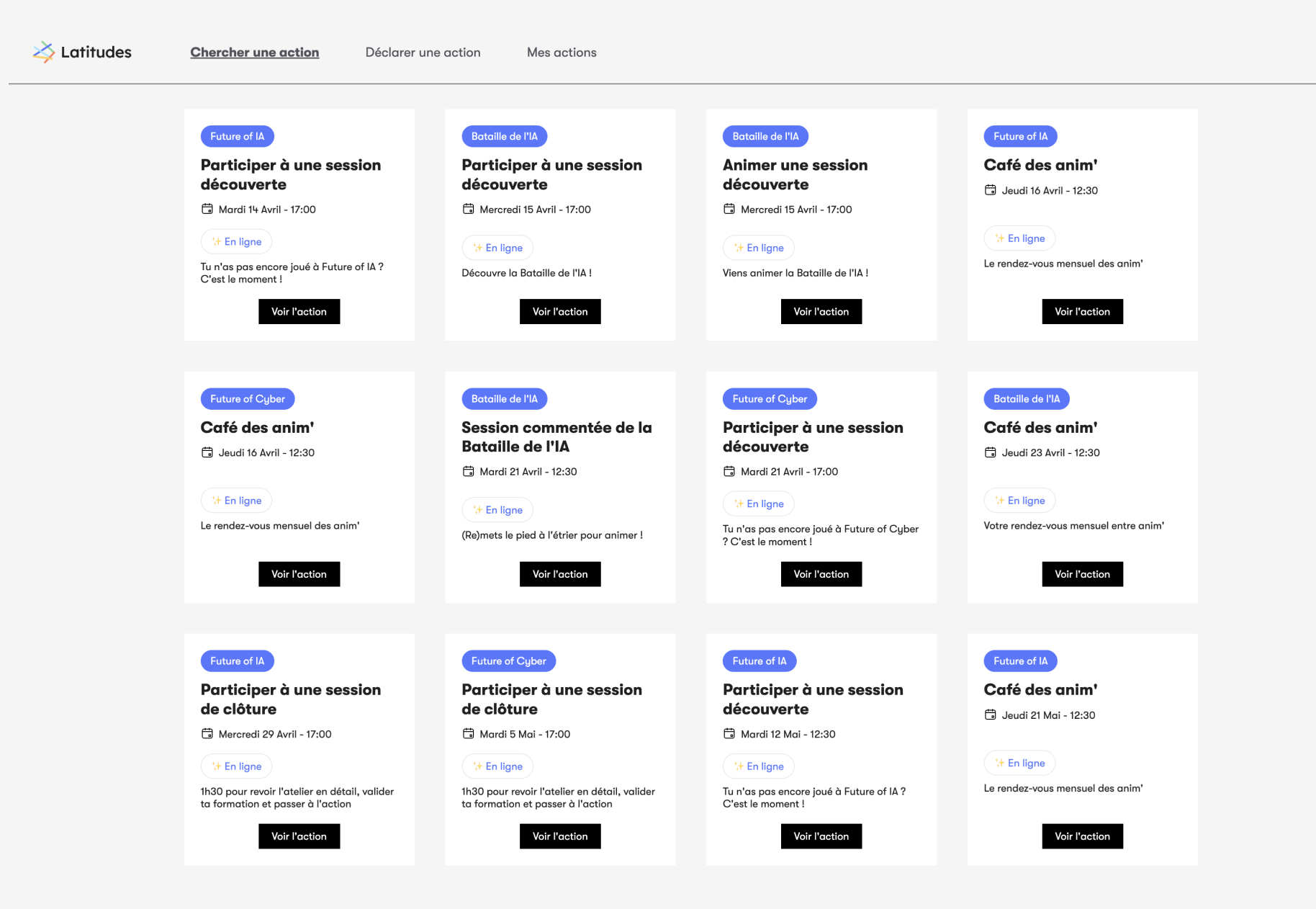

Nous avons conçu plusieurs programmes dédiés aux établissements du supérieur. L'an passé, plus de 700 enseignants et bénévoles se sont appuyés sur nos outils pédagogiques pour aborder le numérique, ses enjeux et ses impacts, dans des cours et ateliers ouverts à toutes et tous.

Si vous souhaitez aborder les enjeux et impacts de l'IA en classe, voici quelques formats signés Latitudes qui pourraient vous intéresser :

- La Bataille de l’IA : Un jeu de cartes collaboratif pour explorer les enjeux sociaux et environnementaux de l’IA Générative en 2h – imaginé par les associations Latitudes et Data for Good.

- Le parcours Sobriété Numérique : Un parcours pédagogique clé en main pour aborder la sobriété numérique en cours, avec des activités prêtes à l'emploi, simples à animer et faciles à mettre en œuvre.

- Open Data University : Un programme qui propose aux établissements de formation à la data de mobiliser leurs élèves sur des challenges qui répondent à des enjeux sociaux et environnementaux grâce à la réutilisation de données ouvertes. Deux défis IA sont ouverts pour cette année !

🎨 Illustration réalisée par Carole Flamion

.png)