La question figure parmi les plus récurrentes. Dans les universités, les salles de classe ou dans les couloirs : qui utilise l’IA générative ? À quelle fréquence ? Et pour quelle utilisation ?

En deux ans à peine, l’IA générative a quitté les laboratoires pour s’installer dans nos quotidiens, jusqu’à devenir un sujet omniprésent dans les débats publics comme dans nos usages les plus ordinaires. Pourtant, dans la plupart des établissements de l’enseignement supérieur, tout cela reste une affaire individuelle. Le manque de cadre se fait sentir, et beaucoup d’enseignants et d’enseignantes se retrouvent démunis face à une révolution qui avance plus vite que leurs programmes.

Aujourd’hui, la question n’est plus de savoir si on est pour ou contre l’IA dans nos vies personnelles et professionnelles, mais d’apprendre à s’en servir pour la mobiliser de manière appropriée, bénéficier des potentiels qu’elle peut offrir tant pour l’amélioration de nos capacités intellectuelles que pour affronter les enjeux sociétaux auxquels nous sommes confrontés, tout en maîtrisant les risques. - Rapport « IA et enseignement supérieur : formation, structuration et appropriation par la société », juin 2025.

Au sein de ce rapport, écrit par Frédéric Pascal, François Taddei, Marc de Falco et Emilie-Pauline Gallié l’une des premières recommandations est de « Mutualiser les capacités de calcul, les contenus et les bonnes pratiques visant à s’approprier et développer les usages de l’IA, tant dans le domaine de la formation que des services administratifs. »

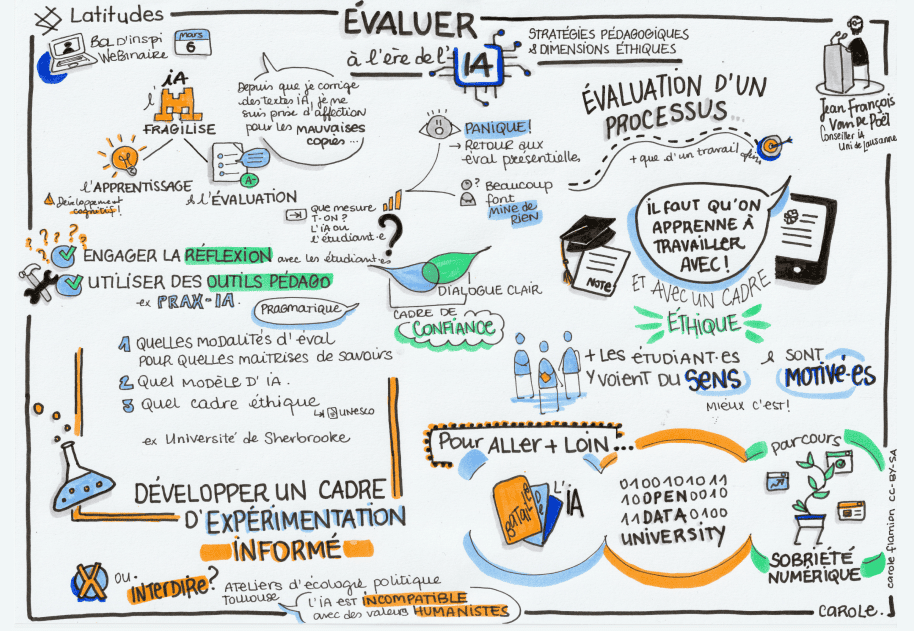

Et c’est justement dans cette perspective que nous avons organisé notre premier Bol d’inspi vendredi dernier, un webinaire dédié aux acteurs et actrices de l’enseignement supérieur. Au programme de celui-ci : une prise de recul sur les usages de l’IA dans l’enseignement pour ouvrir le débat sur les transformations qu’elle initie déjà. Pour cette première édition, nous avons eu la chance d’accueillir François Taddéi, co-auteur du rapport mais aussi cofondateur et président du Learning Planet Institute.

Un paysage hétérogène

Dès les premières minutes du webinaire, François Taddéi pose le constat : l’usage existe, le cadre manque. D’ailleurs, les résultats du rapport IA et enseignement supérieur en témoignent : si l’usage de l’IA progresse rapidement, son intégration institutionnelle reste très inégale. Même si environ 43 % des enseignants et enseignantes les utilisent déjà au quotidien, la majorité n’a reçu aucune formation sur le sujet.

Autrement dit, beaucoup s’y mettent, mais chacun et chacune à sa manière. Les pratiques se développent la plupart du temps au bon vouloir de l’enseignant ou de l’enseignante, souvent dans l’expérimentation personnelle. François Taddéi souligne que cette dynamique, aussi stimulante soit-elle, « repose largement sur du bricolage » : beaucoup utilisent l’IA sans en mesurer pleinement les limites, les biais ou les implications éthiques.

Ce constat révèle l’absence d’une vision partagée au sein du monde universitaire. Là où certains établissements commencent à proposer des formations, d’autres peinent à se positionner. Ce qu’il manque, c’est un cadre commun pour permettre aux établissements d’apprendre les uns des autres, de partager leurs expériences et de bâtir une culture collective de l’IA.

Repenser la mission de l’université

L’IA interroge le rôle même de l’enseignant et de l’enseignante. Pour beaucoup, on craint un risque de remplacement, pour d’autres, on parle de la nécessité d’augmenter le nombre de personnes qui exercent ce métier à mesure que l’accompagnement humain devient plus essentiel.

Mais pour François Taddéi, le sujet dépasse largement la question du poste ou de la fonction. L’arrivée de l’IA invite à repenser en profondeur le système : quel est le rôle des enseignants et enseignantes ? Pourquoi va-t-on à l’école ? Quel est le rôle d’une université ?

« Ce n’est pas l’enseignant seul qui doit se repenser. C’est l’ensemble de l’université qui doit repenser sa mission. »

L’IA, rappelle-t-il, aura un impact sur presque tous les métiers. Et c’est précisément pour cela que l’université a un rôle central à jouer : c’est un lieu où se croisent des étudiantes et étudiants venus de tous les horizons et où on retrouve toutes les disciplines. C’est aussi un espace à mission d’intérêt général, doté d’un ancrage territorial fort et de relations internationales importantes.

« La mission de l’université, c’est justement de s’approprier ce qu’est l’IA, et de permettre à l’ensemble des acteurs, dont les étudiants, mais aussi ceux du territoire, de se l’approprier à leur tour. »

En somme, l’université ne peut pas « prendre la vague de l’IA seule ». Elle doit devenir un espace d’expérimentation éclairée pour mobiliser l’IA générative de manière appropriée.

Mutualiser les réflexions, du générique au disciplinaire

Nous l’avons vu, l’un des rôles majeurs de l’université sera de créer des espaces de réflexion partagée. Mais pour que ces échanges débouchent sur une véritable boussole commune, il faudra être capable de s’adapter au contexte. Car d’une discipline à l’autre, que l’on parle de droit, de philo ou de biologie, l’IA n’aura pas le même impact.

François Taddéi insiste sur la nécessité de mener des réflexions à deux niveaux : à la fois génériques, au sein des universités, pour délimiter un cadre commun et disciplinaire, pour adapter ce cadre aux réalités propres de chaque domaine.

Les doyens et doyennes pourraient jouer un rôle clé, en structurant des temps d’échanges entre enseignants et enseignantes, chercheurs et chercheuses, et étudiants et étudiantes autour de cette question essentielle : « Qu’est-ce que l’IA est en train de changer dans notre discipline ? ».

Certaines universités comme Sciences Po Aix ont déjà amorcé ce travail, en organisant des conférences citoyennes. Ces formats, ouverts et participatifs, permettent de réunir l’ensemble des membres de la communauté éducative des établissements de l'enseignement supérieur (en intégrant bien sûr les étudiants et étudiantes) pour débattre des usages, questionner les valeurs, et proposer des pistes d’action concrètes. C’est par ce type de démarche que l’université peut espérer construire une intelligence collective.

Repenser la pédagogie et l’évaluation

L’IA oblige à repenser les modalités d’évaluation. François Taddéi le souligne, si chacun dispose d’un outil capable de produire un texte ou une analyse à la demande, la question n’est plus seulement de vérifier ce que l’élève sait, mais ce qu’il ou elle comprend.

Certains pays, comme le Danemark, sont par exemple beaucoup plus en avance que la France à ce sujet. Là-bas, on évalue en condition réelle : on autorise les livres, Internet, et même parfois l’IA. Ce qui importe, c’est que les étudiants et étudiantes soient capables d’aller au-delà, de produire avec l’IA des analyses plus fines, et qu’on leur propose, en retour, des défis plus complexes.

Autre exemple, l’Université de Sherbrooke (Québec) qui propose une approche basée sur la transparence à ses étudiants et étudiantes. Pour chaque situation d’apprentissage ou d’évaluation, l’enseignant ou l’enseignante doit indiquer clairement aux élèves dans quelle mesure ils peuvent utiliser les outils d’IA générative. Ces niveaux d’autorisation servent ainsi de repères pour encadrer les usages.

Mais repenser l’évaluation, c’est aussi revoir ce que l’on choisit de mesurer. « Parmi les choses qui émergent et que je trouve très intéressantes, ce sont des évaluations où on évalue un impact sur le monde », explique François Taddéi.

« Par exemple, si vous êtes en informatique, est-ce que vous avez écrit des logiciels open source ? (…) Est-ce que vous avez été capable, pas simplement de réciter le savoir d'hier, mais d'affronter un problème d'aujourd'hui et lui apporter une réponse originale ? Et cette réponse, si vous avez été capable de la co-créer avec d'autres, avec y compris des machines, tant mieux, ça veut dire que vous êtes capable de mobiliser les ressources autour de vous pour résoudre des vrais problèmes. »

Autrement dit, face aux défis auxquels la société est confrontée aujourd’hui, nous avons besoin de personnes capables de résoudre de vrais problèmes tout en intégrant les enjeux éthiques, environnementaux et citoyens dans leurs choix.

Créer des communs pour apprendre ensemble

S’il ne fallait retenir qu’une seule recommandation de François Taddéi, ce serait celle-ci : créer des communs. Quand les usages se multiplient à l’heure où j’écris ces lignes, mutualiser apparaît comme une nécessité.

Dans le rapport IA et enseignement supérieur, la création de communs figure parmi les priorités. L’objectif : permettre à tous les établissements, quelle que soit leur taille ou leurs moyens, d’accéder à des outils, des modèles et des pratiques partagés. « Cette mutualisation permettra des gains de temps et la réalisation d’économies (..) et doit permettre également d’éviter d’accroître les inégalités entre établissements, voire idéalement de les réduire. »

Mais au-delà de l’aspect technique, il s’agit surtout de fabriquer une culture commune de l’usage responsable.

« Mutualiser, c’est apprendre ensemble, pas chacun dans son coin », souligne François Taddéi. « C’est une manière d’éviter que les établissements avancent en silos, et de permettre à tous d’innover à partir d’un socle partagé. »

Créer des communs, c’est donc aussi créer du lien : entre établissements, entre disciplines, entre générations. C’est reconnaître que dans cette nouvelle ère du savoir, personne n’avance seul(e).

Enfin, au fil des échanges, une inquiétude demeure : celle d’une régression cognitive. Est-ce qu’il y a encore du sens à apprendre dans un monde où l’IA semble tout savoir ?

François Taddéi y voit au contraire une forme de paradoxe. L’IA, dit-il, peut devenir un espace d’apprentissage où l’on a « le droit à l’erreur ». En guise d’exemple, Kevin Huy enseignant-chercheur médecin au MCU-PH à Montpellier a créé un dispositif où un bot d’une IA mime un patient. Les élèves doivent donc interagir avec l’IA qui va ensuite analyser leur comportement, à la fois sur le fond et sur la forme.

Pour François Taddéi, « face à l’IA, on a le droit à l’erreur. Cette capacité à simuler des situations complexes permet d’abaisser les peurs, de développer des compétences essentielles, et de cultiver ce qu’il y a de plus humain en nous. Et je pense que typiquement, à l'heure de l'IA, l'humanité du médecin va être encore plus nécessaire. »

Au sein de Latitudes, nous sommes convaincus que l’enjeu ne réside pas seulement dans la maîtrise de l’outil, mais dans la lucidité de son usage - ou - de son non-usage 🙂.

Si l’IA générative devient peu à peu un réflexe, interroger son utilisation et/ou les réponses qu’elle produit devrait le devenir tout autant.

D’autres apprentissages méritent d’être rappelés ici :

- Prenez le temps de comprendre ce qui se joue derrière le numérique, au-delà des interfaces

- Interrogez ses impacts : sociaux, environnementaux, démocratiques. Le numérique n’est jamais neutre.

- Cultivez votre esprit critique, apprenez à douter, à croiser les sources, à vous forger une opinion éclairée.

- Expérimentez, manipulez les outils pour de vrai, mettez-les au service d’enjeux qui comptent pour vous.

- Choisissez votre numérique, celui qui correspond à vos valeurs, à votre éthique, à votre façon d’habiter le monde.

Et c’est peut-être là le rôle le plus précieux de l’enseignement supérieur : former des esprits critiques, capables non seulement de dialoguer avec la machine, mais surtout de penser par eux-mêmes.

👉 Si le sujet vous intéresse, on organise tous les mois une Bataille de l’IA pour toutes et tous en ligne. Il s’agit d’un atelier pour découvrir les enjeux sociaux et environnementaux de l’IA générative ! Pour vous inscrire, c’est par ici.